Neuroinformatik: Die neuronalen Netze werden erwachsen

Ein Computer, der Sprache verstehen oder Gesichter erkennen kann: Seit den Zeiten der Elektronenröhre und der Lochkarten verfolgt die Informatik das Ziel, ihre Geräte mit menschlichen Wahrnehmungsfähigkeiten auszustatten. Jahrzehntelang blieb das eher ein Traum, Erfolge gab es nur wenige. Heute jedoch können wir uns in ganz gewöhnlicher Sprache mit unserem Mobiltelefon über das Wetter oder den Ausgang des letzten Fußballspiels unterhalten. Und Facebook und Google+ erkennen Gesichter so gut, dass sie uns zeigen, auf welchen Fotos unsere Freunde zu sehen sind.

Welcher Errungenschaft haben wir diesen Durchbruch zu verdanken? Eine Vielzahl von algorithmischen und statistischen Methoden hat dazu beigetragen, ebenso wie leistungsfähigere Hardware. Aber ohne ein Konzept namens Deep Learning wäre diese rasante Entwicklung nicht möglich gewesen.

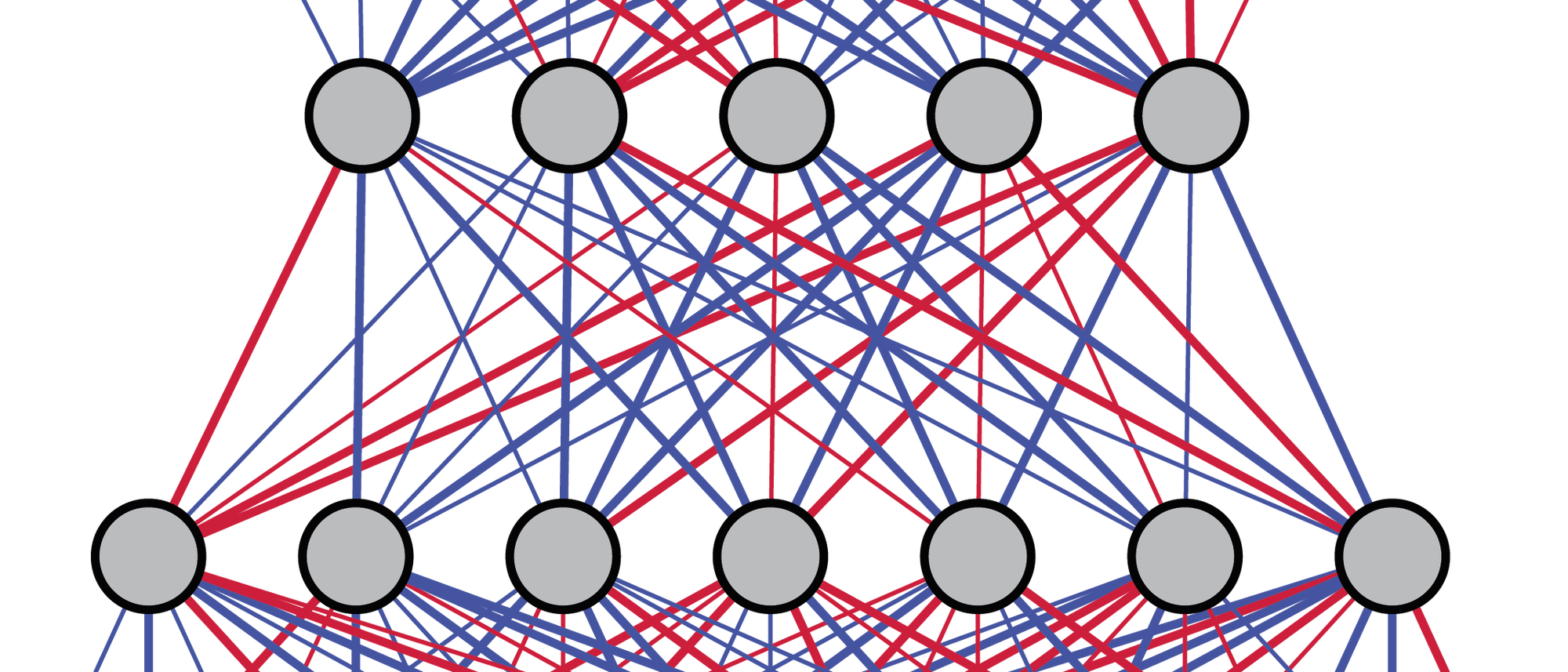

Ein lernender Computer ist in aller Regel als "neuronales Netz" organisiert, das heißt, er besteht aus lauter Elementen, die den Neuronen eines echten Gehirns nachempfunden sind. Bei der visuellen Objekterkennung etwa sind diese Neurone so in Schichten angeordnet wie im Sehsystem des Menschen: Die optischen Signale treffen in der Eingabeschicht der Netzhaut ein und gelangen über eine Abfolge weiterer Schichten bis zur letzten, die Bildelemente wie einen Strich oder ein Gesicht erkennt. Ein neuronales Netz, das zum "tiefen Lernen" fähig ist, verfügt über eine große Zahl solcher Verarbeitungsschichten.

Diese "tiefen Methoden" stecken hinter Spracherkennungssystemen wie Siri von Apple oder Voice Search von Google ebenso wie hinter dem maschinellen Sehen, das der Gesichtserkennung zu Grunde liegt. Zudem beflügeln sie das Data Mining: die Untersuchung großer Datensätze auf bedeutungsvolle Muster.

Wie funktionieren diese tiefen Programme? Sonderbarerweise weiß das keiner ganz genau. ...

Schreiben Sie uns!

1 Beitrag anzeigen