Human Brain Project: Die ultimative Simulation des Gehirns

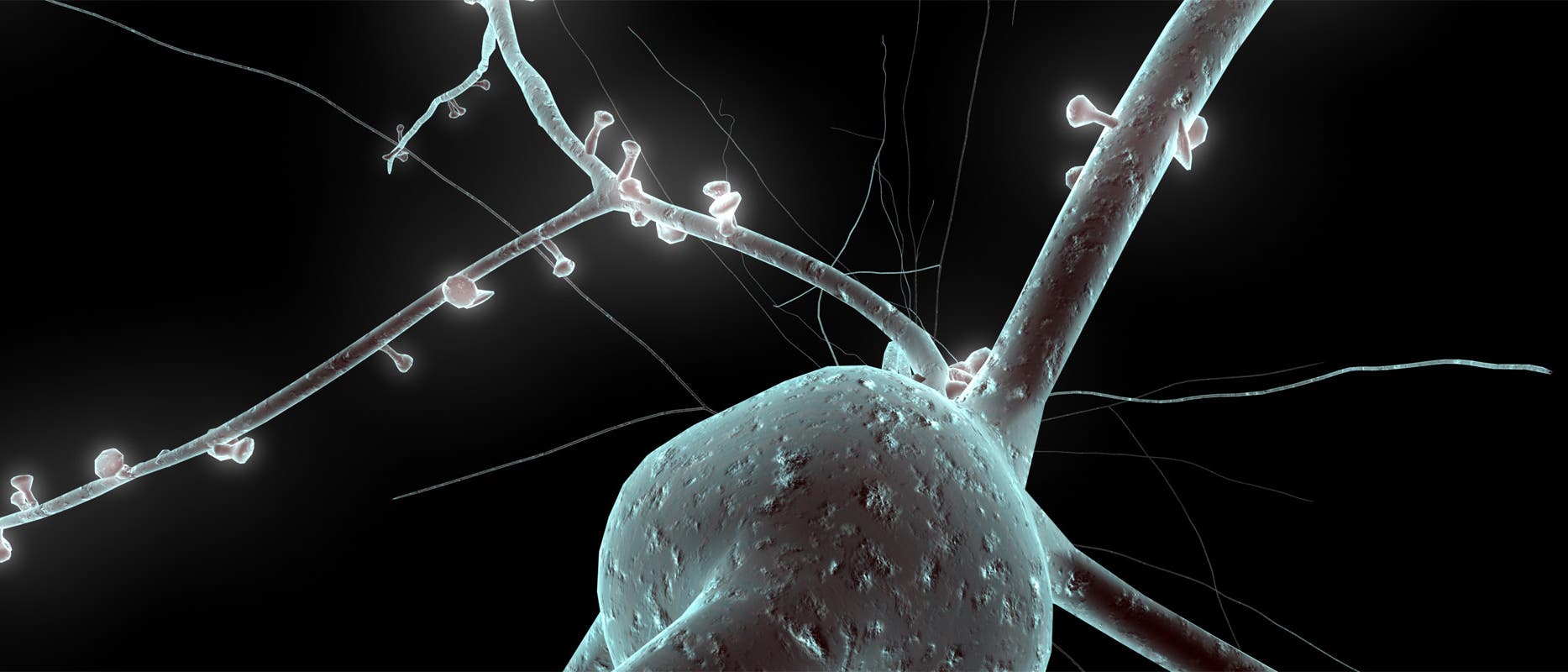

Im Jahr 1906 erhielt Santiago Ramón y Cajal gemeinsam mit Camillo Golgi den Nobelpreis für Physiologie und Medizin: Ramón y Cajal hatte maßgeblich – dank Golgis Färbemethode – dazu beigetragen, dass die Menschheit fortan wusste, womit sie dachte: mit einem hochkomplexen Geflecht aus Nervenzellen, die untereinander Signale austauschen.

Dennoch: Würde man den Spanier per Zeitmaschine ins Jetzt befördern, er dürfte sich wundern, wie wenig Neurowissenschaftler seitdem wirklich verstanden haben. Wenn das Denken im Austausch von Nervensignalen besteht, nach welchen Prinzipien gehen sie dabei vor? Zählt das Feuern jeder Zelle? Oder muss man über viele Neurone mitteln? Steckt die Information im Zeitpunkt der Entladungen, in deren Summe, Häufigkeit oder Abstand? Wie findet man gar Gedächtnis, Sprache oder Bewusstsein in den Nervennetzen?

Flaggschiff-Initiative

spektrumdirekt stellt Ihnen alle Finalisten in der Bewerbung um die milliardenschwere Förderung im Rahmen der EU-Flaggschiff-Initiative vor.

Mehr zum Thema und alle anderen Beiträge der Serie finden Sie hier:

spektrumdirekt.de/flaggschiffe

Zwar haben sich die Erkenntnisse in den über hundert Jahren seit Ramon y Cajals Entdeckung dramatisch vermehrt. Die Zahl allein in der letzten Dekade veröffentlichter Hirnforschungsarbeiten dürfte im Bereich einer halben Million liegen; doch der entscheidende Geistesblitz war nicht darunter.

Jetzt soll dem Gehirn endlich sein Geheimnis abgetrotzt werden: mit viel Geduld und Arbeit – und der Hilfe einer gewaltigen Maschine. Das "Human Brain Project" hat sich vorgenommen, in den kommenden zehn Jahren ein nahezu komplettes menschliches Großhirn auf einem Supercomputer zu simulieren. Der Bedarf für ein tieferes Verständnis des Gehirns ist da – und er ist drängend. Aber ist eine solche Simulation geeignet um Abhilfe zu schaffen?

Mindestvoraussetzung für den Erfolg wäre jedenfalls die eine Milliarde Euro Fördergelder, um die sich Projektleiter Henry Markram, Neurowissenschaftler von der ETH Lausanne, und die Mitglieder der gut hundert assoziierten Forschungseinrichtungen beworben haben. Sie wird im Rahmen der Flaggschiffinitiative der EU ausgeschüttet. Das "Human Brain Project" (HBP) – das unter die sechs Finalisten im Wettbewerb gewählt wurde und nun in der zweijährigen Ausarbeitungsphase ist – hofft auf die Zusage im nächsten Jahr.

Visionäres Projekt sondergleichen

Laut ihren eigenen Anforderungen sucht die Flaggschiffinitiative nach "ehrgeizigen, visionären Projekten", und in dieser Hinsicht lässt das HBP wohl nichts zu wünschen übrig.

In der Tat, sollten Markram und Kollegen Erfolg haben und eine funktionierende Simulation zu Wege bringen, würden sie Neurowissenschaft, Psychologie, Philosophie und nicht zuletzt die Technik revolutionieren. All diese Disziplinen hätten ein einzigartiges neues Werkzeug zur Hand, das den Erkenntnisgewinn dramatisch beschleunigen dürfte. An einem simulierten Gehirn ließen sich Experimente wieder und wieder durchführen, die Parameter frei wählen und obendrein die Resultate bis ins Detail aufzeichnen – ganz ohne die aufwändigen und oft nur indirekten Beobachtungsmethoden der heutigen Hirnforschung wie Magnetresonanztomografie oder Einzelzellableitung.

Tatsächlich sind diese Verfahren, die immer nur den Blick auf Ausschnitte des Gesamtsystems zulassen, Fluch und Segen der Hirnforschung. Sie haben zu einem kaum mehr zu überblickenden Wust an Veröffentlichungen geführt, meint Projektleiter Henry Markram. Wie wirkt Neurotransmitter A auf Ionenkanal B, wenn gleichzeitig Substanz C anwesend ist? Diese und ähnliche Fragen werden derzeit in den Journals in tausenderlei Varianten durchgespielt.

Werkzeug der Kooperation

Genau hier soll sich die zentrale Tugend des Human Brain Projects entfalten, hofft der Forscher. Sein Plan ist es, mit der Simulation der Forschergemeinde ein Standardisierungswerkzeug zur Verfügung zu stellen, in dem alle diese Teilergebnisse integriert werden können. Im Lauf der Zeit würde die simulierte Nervenzelle oder deren Netzwerke immer akkurater die Natur abbilden. Mit seinem "Blue Brain Project" verfolgt er diese Idee bereits seit dem Jahr 2005.

Damals hatten sich die Forscher noch ein wesentlich niedrigeres Ziel gesteckt: Sie wollten einen vertikalen Ausschnitt aus der Hirnrinde einer Ratte, eine so genannte kortikale Säule, in einem Supercomputer realisieren, was ihnen nach eigenen Angaben mittlerweile auch gelungen ist. Allerdings umfasst eine solche Säule nur ungefähr 10 000 Neuronen – und damit gerade einmal einen winzigen Bruchteil der 100 Milliarden Zellen des menschlichen Kortex. Dennoch sind Markram und Kollegen zuversichtlich, auf den dabei gemachten Erfahrungen aufbauen zu können.

Neben den rein neurowissenschaftlichen Erkenntnissen erhoffen sich die Teams des HBP jedoch vor allem revolutionäre Neuerungen in technologischer Hinsicht. Denn unsere neuronale Denkmaschine bewältigt nicht nur manche Probleme besser als herkömmliche Computer, sie verbraucht dazu auch wesentlich weniger Energie. Den Grund dafür vermuten Wissenschaftler in ihrer Arbeitsweise. Statt auf Hochgeschwindigkeit und Präzision wie moderne Prozessoren setzt das Gehirn auf ein Sammelsurium langsamer, fehleranfälliger Bauteile. Erst ein vermutlich sehr raffiniertes, aber in den Details noch unbekanntes Verfahren befähigt dieses System dazu, Informationen zuverlässig zu verarbeiten.

Computer nach Gehirnprinzip

Gelänge es, den entscheidenden Kniff der Natur nachzuahmen, wären zum Beispiel Roboter denkbar, die ihren heutigen Kollegen mit ihrer langsamen Software und ihrer stromhungrigen Elektronik einfach davonlaufen und dabei die Beweglichkeit einer Maus an den Tag legen. Auch in der Sensortechnik könnte ein "neuromorpher" Chip nach Hirnprinzip von unschätzbarem Vorteil sein, wenn er große Datenmengen in Windeseile auf die darin enthaltenen Muster absucht.

Teil des HBP-Konsortiums ist daher beispielsweise auch das Kirchhoff-Institut für Physik in Heidelberg, an dem schon seit längeren an Chips geforscht wird, die die Arbeitsweise des Gehirns nachahmen. Der Plan von Karlheinz Meier und Forscherkollegen ist nun, die enorm detailreichen Modelle aus Markrams zentralem Simulationscomputer zu brauchbarer Hardware zu destillieren. Statt herkömmlicher Transistoren könnten diese Chips mit neuronenähnlichen Einheiten arbeiten, die sich untereinander nach biologischen Lernprinzipien verknüpfen.

Analog dazu rekrutieren sich auch viele der übrigen Mitglieder des Konsortiums aus den avisierten Anwendungsgebieten: Die Technische Universität München plant den Bau von Robotern, die sich an simulierte Gehirne anschließen lassen. In einem "geschlossenen Kreislauf" soll der Roboter irgendwann das virtuelle Hirn mit Sinnesdaten versorgen, welches seinerseits den Roboter steuert. Andere Einrichtungen widmen sich der Entwicklung von Gehirn-Computer-Schnittstellen, dem Sammeln medizinischer Daten, um damit eines Tages Simulationen des kranken Gehirns erstellen zu können, den ethischen, rechtlichen und sozialen Aspekten der Forschung sowie der Vermittlung des neugewonnenen Wissens.

Durchbruch in den ExaFLOP-Bereich

Eine der wesentlichsten Aufgaben jedoch wird das Forschungszentrum Jülich zu stemmen haben. Denn den dortigen Experten obliegt maßgeblich die Entwicklung und Betreuung der gesamten Rechnerinfrastruktur. Und diese wird – der Aufgabe angemessen – gigantisch. Etwa um den Faktor 1000 muss sie schneller sein als die derzeit leistungsfähigsten Riesenrechner, oder, in der Sprache der Informatiker ausgedrückt: Die Grenze zum ExaFLOP-Bereich (das heißt 1018 Gleitkommaoperationen pro Sekunde) muss durchstoßen werden.

Ein imposanter Wert, der jedoch in der Branche als realistisches Ziel gilt. Verschiedene Forschergruppen widmen sich weltweit Rechnern dieser Geschwindigkeit. Aktuellen Schätzungen zufolge soll die Exa-Barriere Ende des Jahrzehnts, etwa um das Jahr 2018 herum, erreicht werden. Das entspricht also durchaus dem Zeitplan des HBP. Offen bleibt dabei noch, für welchen Abstraktionsgrad der Simulation diese Anforderungen kalkuliert worden sind. Der vage Ausdruck "ein ganzes Gehirn" kann sowohl bedeuten, jeden Ionenkanal einzeln zu berücksichtigen, als auch das Geschehen im Innern von Nervenzellen oder gar ganzen Zellverbänden auszuklammern und diese als singuläre Blöcke zu behandeln. Tatsächlich planen die Forscher, Simulationsmodelle auf ganz unterschiedlichen Ebenen zu entwickeln und dann die Erkenntnisse aus dem Kleinen ins Große zu übertragen. Selbst ein ExaFLOP-Rechner dürfte in die Knie gehen, wenn er etwa die Neurotransmitterkonzentration in jeder der Hundert Milliarden Zellen berechnen soll.

Doch selbst dann ist es mit Rechenleistung allein nicht getan, wissen auch Markram und Kollegen. Simulation und Interpretation stellt die Forscher vor ein nicht minder gewaltiges Softwareproblem, für das laut Projektbeschreibung "Durchbrüche in der Mathematik und Softwareentwicklung nötig" und offenbar fest eingeplant sind.

Daten, Daten, Daten

Bleibt noch die Forschung am Original. Auch wenn die HBP-Mitglieder planen, auf den umfangreichen Wissensschatz aus der bisherigen Hirnforschung zurückzugreifen – noch bei weitem sind nicht alle notwendigen Daten bekannt. Eine Schlüsselstellung nimmt dabei die so genannte funktionale Konnektomik ein, eine Analyse des Verknüpfungsmusters von Nervenzellen einer Hirnregion, bei der gleichzeitig das Verhalten der Neurone aufgezeichnet wird. So mussten beispielsweise die Wissenschaftler der ETH Lausanne für ihre Nachbildung der Säule aus dem Rattenkortex im Rahmen des älteren Blue-Brain-Projekts zuallererst per Einzelzellableitung erfassen, wie sich in diesem Schaltkreis Erregungen ausbreiten, und anschließend mit Elektronenmikroskopen dessen Verkabelung bestimmen. Das Verfahren ist so komplex und zeitraubend, dass ihnen dies selbst für dieses beschränkte Gesamtsystems nur ausschnittsweise gelang. Zur vollständigen Simulation gelangten sie daher nur durch Extrapolation der vorherrschenden Muster.

Für den allergrößten Teil der menschlichen Großhirnrinde liegen entsprechende Schaltkreisdaten jedoch noch überhaupt nicht vor. Allerdings haben sich bereits eine Anzahl internationaler Teams der Herausforderung gestellt, diese zu ermitteln. Standardisierte Techniken, die den Erfassungsvorgang automatisieren und dadurch einen deutlich erhöhten Durchsatz erreichen, könnten die nötige Datenmenge in den kommenden Jahren schrittweise liefern. Trotzdem bleiben die Schwierigkeiten immens. Der Konnektomforscher Jeffrey Lichtman von der Harvard University rechnete beispielsweise vor, dass ein vollständiges Konnektom – also das kleinräumige Verknüpfungsmuster aller Nervenzellen – 100 Mal mehr Daten umfassen würde, als derzeit auf den Servern von Google gespeichert sind. Das Konnektom einer Maus, wohlgemerkt.

Doch damit nicht genug. Darüber hinaus benötigt das HBP laut seiner Projektbeschreibung umfassende Daten über die Genaktivität in Nervenzellen, die Proteinzusammensetzung, die Zellphysiologie sowie die mittel- und großskaligen Verknüpfungsmuster auf der Ebene ganzer Zellverbände und Hirnareale. Erst die Kooperation mit externen Partnern an Universitäten und in der Industrie soll die benötigten Datenmengen beschaffen.

Zum Scheitern verurteilt?

Kurzum: Henry Markram hat sich einer Aufgabe gestellt, dass einem schwindlig werden könnte. Der Forscher gilt in der Szene als charismatischer, beredter, mitunter schwieriger Charakter. Der "Zeit" gegenüber sagte etwa Thomas Metzinger, Philosoph an der Uni Mainz und Kenner der Neurowissenschaften, zumindest sei Markram "besessen und gewitzt genug, um das Projekt durchzuboxen." Ein Visionär – ohne Frage. Und auch wenn die Simulation eines ganzen Gehirns zu den heimlichen Träumen eines jeden Neuroinformatikers gehören dürfte – statt in die Begeisterung einzustimmen, sind viele seiner Kollegen mittlerweile auf Abstand gegangen.

Dass die Herausforderung irgendwie zu stemmen sei und die Zeit reif, ein ehemaliges Sciencefictionprojekt endlich in die Tat umzusetzen, zweifelt ein beträchtlicher Anteil seiner Forscherkollegen an. Mehr noch: Man befürchtet, es mit einem mit hoher Wahrscheinlichkeit zum Scheitern verurteilten Projekt zu tun zu haben, durch das Schaden für die ganze Disziplin droht, heißt es hinter vorgehaltener Hand, denn öffentlich will man das HBP nicht kommentieren. Darauf hat sich die Szene verständigt. Zu viel Sprengkraft, die Gemeinschaft zu entzweien, birgt ein Vorhaben, von dem sich einige Protagonisten große Durchbrüche, Ruhm, Anerkennung und nicht zuletzt eine satte finanzielle Förderung versprechen, und das andere hingegen für aussichtslos, im Ansatz verkehrt und womöglich nahe an der Grenze zur Scharlatanerie halten.

Viele Neuroforscher außerhalb des Konsortiums empfinden das HBP als zweischneidiges Schwert. Wo viel Geld und fähige Leute aufeinander treffen, besteht immer die Chance, dass Außergewöhnliches entsteht, gleichzeitig könnte das Ansehen der Neuroinformatik in der Gesellschaft wachsen und potenziell weitere Geldgeber anlocken. Wer pessimistischer eingestimmt ist, befürchtet den gegenteiligen Effekt. Warum noch kleinere Initiativen unterstützen, wenn sich bereits ein milliardenschweres Konsortium der Sache angenommen hat? Eingeplante Unterstützungszahlen könnten langsam wegbrechen.

Und am Ende, fürchten einige, droht der ganz große Kahlschlag – so wie es der Künstlichen-Intelligenz-Forschung erging. In den 1960er Jahren hatte man weit überzogene Erwartungen geweckt, die das Feld nicht einhalten konnte. Es versackte im "Winter der KI", musste Spott über sich ergehen lassen, Forschungsprogramme köchelten über Jahrzehnte auf kleiner Flamme. Bis heute hat die KI sich nicht vollständig von diesem Schock erholt. Nur langsam bekommt sie ihr Renommee als Zukunftstechnologie wieder. Es gilt, dieses Schicksal zu vermeiden, ohne Markrams Projekt durch allzu harsche Kritik im Vorfeld zu torpedieren.

Simulation ohne Ergebnis

Zu den wenigen, die sich dennoch öffentlich äußerten, zählen Richard Hahnloser, Kevan Martin und Rodney Douglas, allesamt Forscher an der ETH Zürich, dem anderen Schwergewicht unter den Schweizer Forschungseinrichtungen neben der ETH Lausanne. In einem offenen Brief an den "Tages-Anzeiger" bemängelten sie vor allem, dass aus der bisherigen Arbeit am Blue-Brain-Projekt kaum begutachtete Veröffentlichungen hervorgegangen seien. Zwar teilte Markram auf öffentlichen Auftritten, etwa beim Weltwirtschaftsgipfel in Davos, mit, sie hätten wie geplant eine kortikale Säule simuliert. Nachvollziehen, unter welchen Umständen dies geschah, können die Fachkollegen allerdings nicht, denn Publikationen, die darüber Aufschluss geben könnten, fehlen. Es sei "ungeheuerlich für Projekte, die ins Blaue schießen, Hunderte von Millionen auszugeben", schimpfte Richard Hahnloser in der "Neuen Zürcher Zeitung" daher über das Blue-Brain-Projekt.

Überdies blieb Markram der Community den Nachweis schuldig, dass seine Simulationen – so sie denn überhaupt funktionieren – überhaupt in der Lage sind, überzeugende neue Erkenntnisse zu produzieren. Ihm falle beispielsweise auf Anhieb kein interessantes Ergebnis des Blue-Brain-Projekts ein, sagte der Neuroinformatiker Peter König von der Universität Osnabrück dem Schweizer Radiosender DRS2.

Für viele Forscher kommt dieser Mangel nicht überraschend. Kann eine Vorgehensweise, wie sie dem HBP zu Grunde liegt, überhaupt erfolgreich sein? Im Normalfall dienen Simulatoren dazu, an einem abstrahierten Modell der Wirklichkeit Hypothesen zu überprüfen. Markram und Kollegen hingegen scheinen dieses Rezept auf den Kopf stellen zu wollen, heißt es aus den Reihen kritischer Forscher: Hat man genügend Details dem Modell hinzugefügt, kommt irgendwann von allein der Moment, an dem man das Gehirn versteht. Ein animus ex machina.

Doch dieser Hoffnung fehlt die theoretische Untermauerung. Einmal vorausgesetzt, dass die technischen Hindernisse überhaupt überwunden werden können, bleibt stets die Schwierigkeit zu erkennen, welche Eigenschaften des Modells auf willkürliche Annahmen beim Modellierungsprozess zurückgehen und welche dem natürlichen Vorbild entsprechen. Wer die falschen Fragen stellt, bekommt selbst bei der genauesten Simulation keine richtige Antwort.

Zum anderen droht Gefahr, an der wachsenden Komplexität zu scheitern. Die eigentliche Arbeit liegt darin, vom natürlichen Geschehen zu abstrahieren und die entscheidenden Vorgänge zu erkennen. Sonst steht man am Ende schlimmstenfalls vor der paradoxen Situation, dass man Simulationen benötigt, um die Simulation zu verstehen.

Beim spanischen Nobelpreisträger Ramon y Cajal brachte nicht die akribische Arbeit an den Gewebepräparaten allein die Erkenntnis, sondern das Spekulieren über deren inneren Zusammenhang. Und ohne den einen guten Geistesblitz, die eine endlich zutreffende Hypothese, wie das Hirn funktionieren könnte, geht es nicht – auch nicht mit einer Milliarden teuren Simulation. Doch wer weiß, vielleicht schlummert diese Idee ja schon in einem der Projektmitarbeiter. Dann allerdings wäre das künstliche neuronale Feuerwerk genau das richtige Handwerkszeug, um eine medizinische, technische und soziale Revolution einzuleiten, wie sie kaum je in der Geschichte der Menschheit vonstattenging.

Schreiben Sie uns!

1 Beitrag anzeigen