Lobes Digitalfabrik: Dürfen Maschinen über Menschenleben entscheiden?

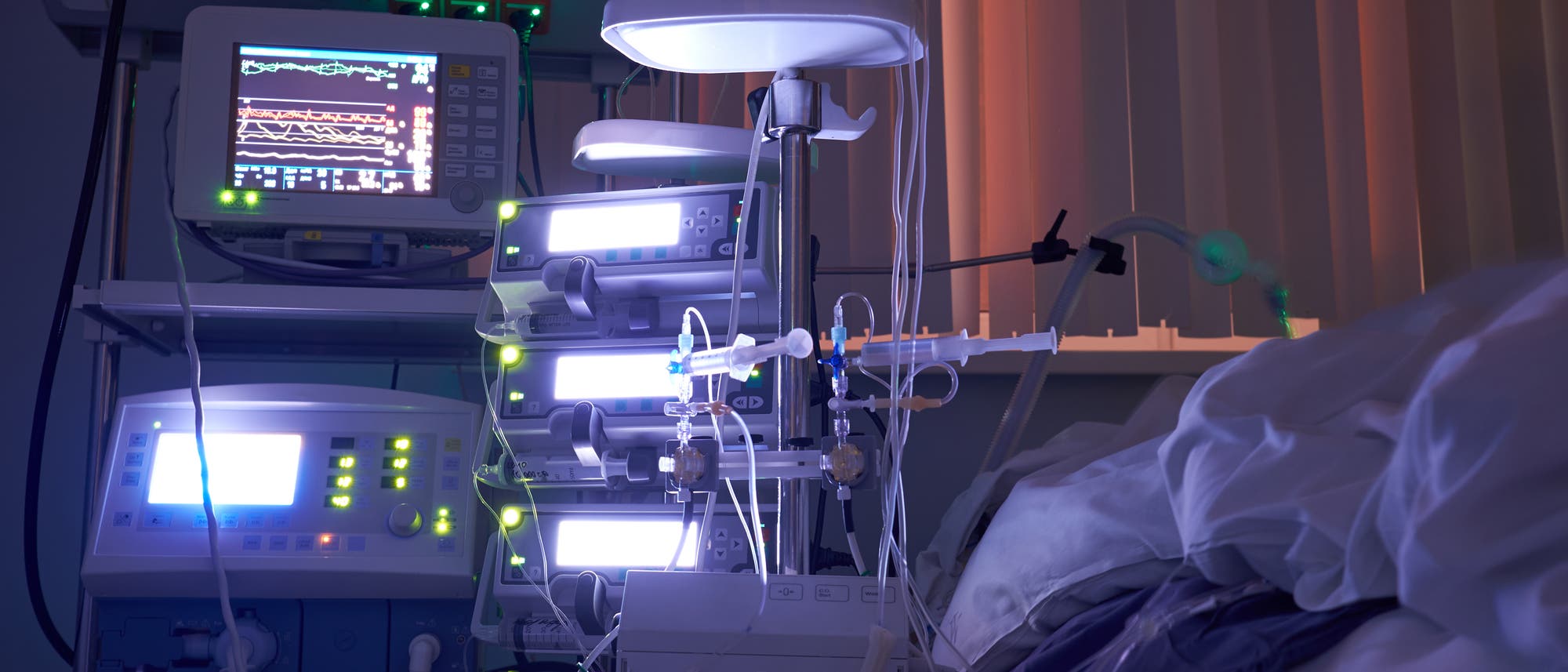

In den Medien ist derzeit häufig von »Triage« die Rede, also einer medizinischen Behandlungspriorisierung. Wenn es auf der Intensivstation an Beatmungsgeräten mangelt, müssen Arzt oder Ärztin nach einer Dringlichkeitseinschätzung entscheiden, welchem Patienten die lebensnotwendige Beatmung zukommen soll.

Die Frage, nach welchen Kriterien man dabei vorgeht, ist ethisch hochproblematisch. Soll man die jüngeren und fitteren Covid-19-Patienten, die eine höhere Überlebenswahrscheinlichkeit haben, weiterbeatmen und die älteren sterben lassen? Oder soll man - gemäß der ursprünglichen Überlegung der Triage - die besonders schweren Patienten prioritär behandeln, weil sie die Beatmung dringender benötigen, aber vielleicht nicht lange überleben? Und wenn alle Intensivbetten belegt sind und ein deutlich jüngerer Patient ins Krankenhaus eingeliefert wird - müsste dann die Beatmung eines älteren Patienten eingestellt werden? Ein ethisches Dilemma, das die Umsetzung einer Handlungspflicht zu einer Tötungshandlung machen kann.

Bundesjustizministerin Christine Lambrecht (SPD) betonte, dass jedes Leben »gleich schützenswert« sei. Auch der Deutsche Ethikrat hat in einer Stellungnahme darauf hingewiesen, dass die Menschenwürde und der Gleichheitsgrundsatz es dem Staat verbieten, »qualitative oder quantitative Kriterien an das menschliche Leben anzulegen«.

Bloß, welche konkreten Handlungsempfehlungen leitet man daraus für die medizinische Praxis ab? Die Mediziner können in einer Stresssituation, in der es um Leben und Tod geht, kein medizinethisches Gutachten verfassen. Zumal die zur Entscheidung notwendigen Informationen über Alter oder Vorerkrankungen teils noch gar nicht vorliegen. Um ihre Mitarbeiter kognitiv und physisch zu entlasten, greifen einige Krankenhäuser bei der Triage daher auf künstliche Intelligenz zurück.

Alle Folgen von »Lobes Digitalfabrik« finden Sie hier.

So setzen zahlreiche britische Krankenhäuser auf ein KI-gestütztes Röntgensystem bei der Erkennung von Lungenentzündungen. Das Screeningtool, das von der indischen Softwarefirma Qure-ai entwickelt wurde, erkennt in Röntgenaufnahmen Muster - etwa entzündetes Gewebe, das sich hell vom gesunden Gewebe abhebt. Normalerweise wird beim Verdacht auf eine Lungenentzündung eine Laboruntersuchung durchgeführt. Weil es aber mitunter zwölf Stunden und länger dauert, bis deren Ergebnisse vorliegen, haben sich Röntgenaufnahmen in der Diagnostik etabliert. Moderne Medizinsoftware benötigt lediglich zehn Minuten, um einen Patienten zu durchleuchten und die Wahrscheinlichkeit einer Lungeninfektion zu berechnen.

Bereits seit den 1990er Jahren nutzen Radiologen computergestützte Diagnoseverfahren. Die maschinelle Bildverarbeitung hat sich seitdem laufend verbessert. Deep-Learning-Algorithmen können schon seit einiger Zeit Krebszellen in hochauflösenden Bilddateien erkennen. Forscher des Helmholtz Zentrums München, der Ludwig-Maximilians-Universität München (LMU) und der Technischen Universität München (TUM) haben einen Algorithmus entwickelt, der mit der Präzision eines geschulten Auges selbst kleinste Metastasen im Körper einer Maus erkennt - und das 300-mal schneller als Fachleute aus der Klinik. Die Algorithmen werden dabei mit tausenden Röntgenbildern trainiert, bei denen sie lernen, eigenständig auffällige Muster zu erkennen.

Laut einer Vielzahl von Studien sollen »Roboterradiologen« dem Menschen in der Diagnostik überlegen sein. Algorithmen operieren präzise und verlässlich, sie werden nicht müde, sind stressresistent und geraten nicht in Panik. Gerade im kaputtgesparten britischen Gesundheitssystem NHS, in dem es an Personal fehlt, kann so eine medizinische Assistenz in Krisenzeiten eine wichtige Entlastung sein. Einem Bericht des Technikmagazins »MIT Technology Review« zufolge helfen die KI-Systeme Ärztinnen und Ärzten bereits bei der Triage von Covid-19-Patienten. Doch was passiert, wenn der Computer eine falsche Diagnose stellt und der Patient daraufhin verstirbt? Wer trägt dafür die Verantwortung? Die Klinik? Ihr medizinisches Personal? Der Softwarehersteller? Das sind ganz neue Fragen, die auf die Arzthaftung zukommen werden.

Wen wollen wir lieber retten?

Man kann diese Entwicklungen zu folgendem Gedankenexperiment verdichten. Einmal angenommen, man würde die Zuteilung der Beatmungsgeräte an einen Algorithmus delegieren. Nach welchen ethischen und moralischen Kriterien würde man diese Triage-KI programmieren? Nach einem utilitaristischen Prinzip, das nach dem (nicht nur medizinischen) Nutzen der Behandlung fragt? Nach dem verfassungsmäßigen Prinzip, dass Leben nicht gegeneinander aufgerechnet werden dürfen und im Zweifel der schutzwürdigere Patient Vorrang genießt? Nach einem amoralischen Zufallsprinzip? Oder nach einem moralischen Prinzip, wonach ein gesunder Lebensstil belohnt und ein ungesunder bestraft wird? Lieber den stärker gefährdeten Raucher beamten und den Nichtraucher ersticken lassen? Oder den Nichtraucher beamten und den Raucher für seinen Tabakkonsum »bestrafen«?

Google hat vor zwei Jahren einen Algorithmus entwickelt, der anhand von Patientendaten mit einer Treffergenauigkeit von 95 Prozent prognostizieren kann, ob ein Mensch binnen eines Jahres sterben wird. Wenn dieses Vorhersageinstrument valide Daten liefert, hätte man ein sehr genaues Sterbe- beziehungsweise »Ablaufdatum« des Menschen. Und das könnte das Tor zu einer quantifizierenden Medizinethik weit öffnen. Wer nur noch zwei Monate auf der Uhr hat, wird abgeschrieben - und nicht mehr beatmet. Das klingt brutal, doch je mehr Daten zur Verfügung stehen, desto trennschärfer kann sortiert werden.

In den USA dürfen Lebensversicherer seit dem Jahr 2019 unter anderem auf Social-Media-Daten wie beispielsweise Instagram-Fotos zurückgreifen. Alkohol- und Tabakkonsum lassen sich mit Algorithmen, die auf Fotos Gegenstände erkennen, recht leicht identifizieren. Zwar stehen der Auswertung sensibler Daten zahlreiche Rechtsvorschriften entgegen (in Europa die DSGVO). Doch es zeigt sich, wie sich durch die permanente Selbstverdatung das ethische Koordinatensystem auf eine utilitaristische Logik zubewegt. Bei allem Nutzen von KI in der Medizin - die Menschlichkeit darf am Ende nicht auf der Strecke bleiben.

Schreiben Sie uns!

Beitrag schreiben