Lexikon der Mathematik: Boltzmann-Maschine

ein Neuronales Netz, welches mit der Boltzmann-Lernregel oder einer ihrer zahlreichen Varianten konfiguriert wird und/ oder im Ausführ-Modus eine mit der Boltzmann-Verteilung oder allgemeiner mit der Fermi-Dirac-Verteilung zusammenhängende Dynamik besitzt.

Im folgenden wird die prinzipielle Funktionsweise einer Boltzmann-Maschine am Beispiel eines entsprechend modifizierten Hopfield-Netzes erläutert (diskrete Variante).

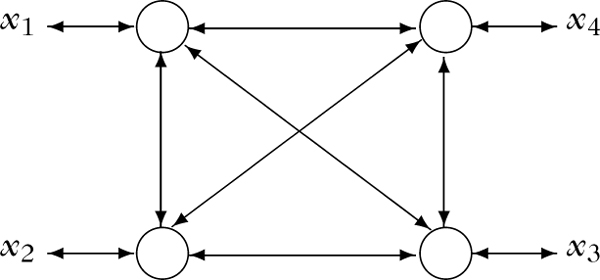

Dieses spezielle Netz ist einschichtig aufgebaut und besitzt n formale Neuronen. Alle formalen Neuronen sind bidirektional mit jeweils allen anderen formalen Neuronen verbunden (vollständig verbunden) und können sowohl Eingabeals auch Ausgabewerte übernehmen bzw. übergeben. Man vergleiche hierzu die Abbildung.

Struktur einer Hopfield-Boltzmann-Maschine

Dem Netz seien im Lern-Modus die bipolar codierten Trainingswerte

\begin{eqnarray}{x}^{(s)}\in {\{-1,1\}}^{n},1\le s\le t,\end{eqnarray}

zur Speicherung übergeben worden und aus diesen die Gewichte\begin{eqnarray}{{\mathscr{W}}}_{ij}=:{{\mathscr{W}}}_{ji}\in {\mathbb{R}},1\le i\lt j,1\le j\le n,\end{eqnarray}

in irgendeinem Lern-Prozeß, z. B. mit der Boltzmann-Lernregel, berechnet worden. Weiterhin sei \({{\mathscr{W}}}_{ij}:=0\) für \(1\le i\le n\).Wird nun dem Netz im Ausführ-Modus ein beliebiger bipolarer Eingabevektor

\begin{eqnarray}X=:{x}^{[0]}=({x}_{1}^{[0]},\ldots, {x}_{n}^{[0]})\text{\hspace{0.17em}}\in {\{-1,1\}}^{n}\end{eqnarray}

übergeben, und wird mit τ > 0 ein beliebiger fester Parameter fixiert, so erzeugt das Netz zunächst eine Folge von Vektoren \({({x}^{[u]})}_{u\in {\mathbb{N}}}\) gemäß\begin{eqnarray}{a}_{j}^{[u]}:=\displaystyle \sum _{j-1}^{i=1}{{\mathscr{W}}}_{ij}{x}_{i}^{[u+1]}+\displaystyle \sum _{i=j+1}^{n}{w}_{ij}{x}_{i}^{[u]},\\ {p}_{j}^{[u]}:=1/(1+\exp (-\frac{{a}_{j}^{[u]}}{\tau })),\end{eqnarray}

\begin{eqnarray}{x}_{i}^{[u+1]}:=\{\,1,\text{\hspace{0.17em}}\text{mit}\text{\hspace{0.17em}}\text{Wahrscheinlichkeit}\text{\hspace{0.17em}}{p}_{j}^{[u]},\\ -1,\text{\hspace{0.17em}}\text{mit}\text{\hspace{0.17em}}\text{Wahrscheinlichkeit}(1-{p}_{j}^{[u]}),\\ {x}_{j}^{[u]}\text{\hspace{0.17em}}\text{falls}\text{\hspace{0.17em}}\text{exakt}\text{\hspace{0.17em}}{p}_{j}^{[u]}-\frac{1}{2}\end{eqnarray}

Für große positive Parameter τ ist die Wahrscheinlichkeit, daß das Netz von einem Zustand in einen anderen übergeht, im allgemeinen nie gleich Null. Läßt man jedoch τ gegen Null konvergieren, so konvergieren die Übergangswahrscheinlichkeiten gegen Null oder Eins, es sei denn sie sind exakt gleich 1/2, und man erhält im Grenzwert die Dynamik des klassischen Hopfield-Netzes.

In der Praxis wird der Parameter τ Schritt für Schritt erniedrigt, verbunden mit der Hoffnung, daß das Netz zunächst ohne zu terminieren in Zustände mit niedrigerer Energie übergeht, um dann im Grenzwert für \(\tau \to 0\) aufgrund der Konvergenz des klassischen Hopfield Ausführ-Modus auf einem Ausgabevektor zu enden, der mit hoher Wahrscheinlichkeit einem gespeicherten Trainingsvektor entspricht (vgl. Hopfield-Netz bzgl. der klassischen Dynamik).

Die sukzessive Erniedrigung des Parameters τ wird auch als „simuliertes Abkühlen” (engl. simulated annealing) bezeichnet.

Wenn Sie inhaltliche Anmerkungen zu diesem Artikel haben, können Sie die Redaktion per E-Mail informieren. Wir lesen Ihre Zuschrift, bitten jedoch um Verständnis, dass wir nicht jede beantworten können.