Quantenfehlerkorrektur: Warum nützliche Quantencomputer plötzlich in Reichweite rücken

Noch vor wenigen Jahren galten leistungsfähige Quantencomputer als fernes Zukunftsversprechen. Inzwischen jedoch wächst die Hoffnung, dass die Wunderrechner, die bei der Lösung extrem komplexer Probleme in Chemie, Kryptografie und Medizin helfen sollen, bereits innerhalb der nächsten zehn Jahre Realität werden könnten. Von einem »vibe shift« spricht Nathalie de Leon, experimentelle Quantenphysikerin an der Princeton University, und beschreibt damit einen spürbaren Stimmungswandel in der Fachcommunity. »Die Leute beginnen wirklich, an den Erfolg zu glauben«, sagt sie.

Das liegt vor allem daran, dass in den vergangenen zwei Jahren etliche entscheidende Fortschritte gemacht wurden – und das in zunehmender Geschwindigkeit. Forschungsteams an Universitäten und Unternehmen, vom kleinen Start-up bis zum großen Technologiekonzern, haben die Fehleranfälligkeit der Quantensysteme drastisch verringern können. Möglich wurde das durch Verbesserungen sowohl bei der Herstellung der Quantenchips als auch bei den Methoden zu deren Kontrolle. Parallel dazu verstehen Theoretikerinnen und Theoretiker immer besser, wie sich vorhandene Quantenhardware effizienter nutzen lässt.

»Zum aktuellen Zeitpunkt bin ich fest davon überzeugt, dass Quantencomputer tatsächlich realisiert werden – und zwar deutlich schneller, als viele angenommen haben«, sagt die Informatikerin Dorit Aharonov von der Hebräischen Universität Jerusalem. »Wir sind in eine neue Ära eingetreten.«

Quantencomputer verarbeiten Informationen in Form von Qubits: Recheneinheiten, die im Gegensatz zu den Bits klassischer Computer nicht nur die Werte 0 oder 1 annehmen können, sondern auch alles dazwischen. Bislang bestehen Qubits aus winzigen Schaltkreisen, Ionen, Atomen oder Defekten in Kristallen, um nur einige zu nennen.

Der Kern einer typischen Quantenberechnung ist eine Abfolge sogenannter Gatter: Operationen, die den Zustand der Qubits gezielt verändern. Solche Gatter können auf ein einzelnes Qubit wirken – etwa indem sie den Spin eines Elektrons um einen bestimmten Winkel drehen – oder auf mehrere Qubits zugleich. Entscheidend ist, dass ein Gatter mehrere Qubits in stark korrelierte, »verschränkte« Zustände versetzen kann. Dadurch wächst die Menge der verarbeitbaren Information exponentiell an. Am Ende jeder Berechnung steht dann eine Messung, die den komplexen Quantenzustand zerstört und als Ergebnis eine Folge gewöhnlicher digitaler Bits liefert.

Quantenfehlerkorrektur wird immer besser

Die jüngsten Fortschritte in dem Forschungsbereich sind deshalb so aufregend, weil sie einige der zentralen Probleme adressieren, die der Entwicklung leistungsfähiger Quantencomputer bislang im Weg standen: ihre Fehleranfälligkeit. In der Praxis können sich Quantenzustände nämlich spontan und unvorhersehbar verändern; nach einiger Zeit geht die darin gespeicherte Information unweigerlich verloren. Zudem können die Gatter und Messungen Fehler produzieren. Sogar scheinbar einfache Operationen, wie das Drehen eines Spins mittels elektromagnetischer Pulse, gelingen nie exakt so, wie sie geplant waren.

Doch im Lauf des Jahres 2025 haben vier Forschungsteams gezeigt, dass diese Probleme lösbar sind. Dazu zählen das Google‑Quantum‑AI‑Labor in Santa Barbara, das Unternehmen Quantinuum aus Broomfield sowie ein Forschungsteam der Harvard University und des Start-ups QuEra. Im Dezember 2025 stieß ein viertes Team von der University of Science and Technology of China (USTC) in Hefei zu diesem Kreis hinzu: Allen vier Gruppen gelang es, eine Technik namens Quantenfehlerkorrektur umzusetzen und weiterzuentwickeln. Sie codierten dabei ein logisches Qubit (das für die Quantenberechnung genutzt wird) durch mehrere physikalische Qubits, um das System weniger störanfällig zu machen.

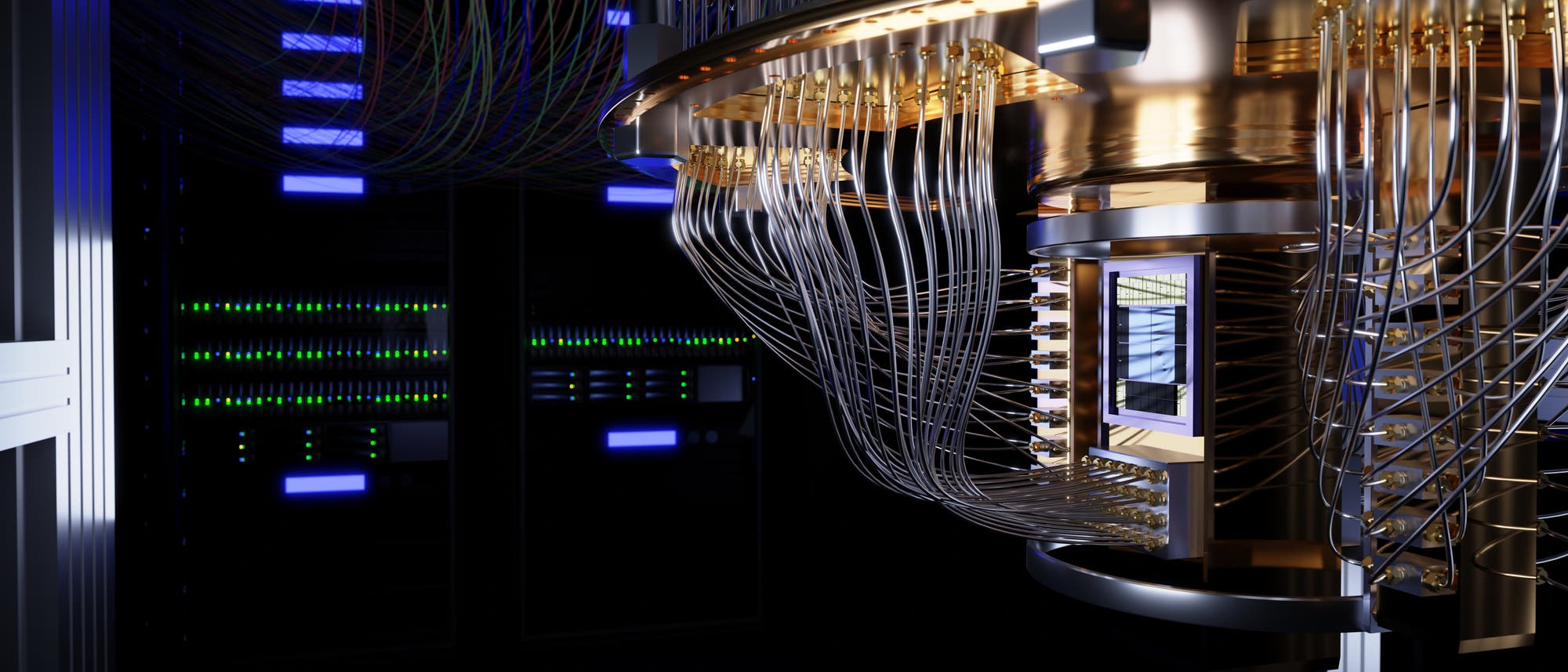

Die Teams von Google und der USTC haben die Quanteninformation im kollektiven Zustand von Elektronen gespeichert, die in winzigen supraleitenden Schaltkreisen zirkulieren. Um zu verhindern, dass die Information zerfällt, haben sie das System auf Temperaturen nahe dem absoluten Nullpunkt gekühlt. Quantinuum hingegen nutzt die magnetische Ausrichtung von Elektronen in einzelnen Ionen, die in elektromagnetischen Fallen gehalten werden. Bei QuEra entsprechen die Qubits einzelnen neutralen Atomen, die durch Lichtstrahlen – sogenannte optische Pinzetten – fixiert werden. Indem man bestimmte physikalische Qubits während der Berechnung gezielt ausliest, kann erkannt werden, ob der Zustand eines logischen Qubits gestört wurde. Falls dem so ist, lässt sich der Fehler durch geschickte Mechanismen korrigieren.

Selbst wenn sie funktioniert, ist die Quantenfehlerkorrektur kein Allheilmittel

Wie jede Operation an Qubits bringt aber auch die Fehlerkorrektur selbst neue Fehler mit sich. In den 1990er-Jahren zeigten Aharonov und andere Fachleute in mathematischen Arbeiten, dass sich dieser Effekt durch wiederholte Anwendung der Fehlerkorrektur prinzipiell beliebig verkleinern lässt. Doch es gibt eine entscheidende Einschränkung: Damit das funktioniert, muss jeder einzelne Schritt der Korrektur den Fehler unter eine bestimmte Schwelle drücken. Und das erwies sich lange als Problem.

Nun haben die vier Teams diesen Schwellenwert allerdings erreicht. Für viele Physikerinnen und Physiker markiert dies einen Wendepunkt: Es ist ein Beleg dafür, dass großskalige, fehlertolerante Quantencomputer grundsätzlich realisierbar sind.

Aber selbst wenn sie funktioniert, ist die Quantenfehlerkorrektur kein Allheilmittel. Lange Zeit schätzten Forschende, dass ein vollständig fehlerkorrigierter Quantenalgorithmus einen enormen Aufwand erfordert: Mindestens 1000 physikalische Qubits wären demnach nötig, um ein einziges logisches Qubit zu codieren. Die bislang größten Quantencomputer verfügen jedoch nur über einige Tausend Qubits. Frühere Überlegungen ließen sogar vermuten, dass für Anwendungen wie die Primfaktorzerlegung Milliarden Qubits erforderlich sein könnten.

Die Primfaktorzerlegung wird seit Langem als Maßstab herangezogen: Quantencomputer, die diese Aufgabe bewältigen können, wären auch leistungsstark genug, um andere bislang unlösbare Probleme anzugehen, etwa die Eigenschaften neuer »Wundermaterialien« vorherzusagen oder den Aktienhandel zu optimieren.

Mehr Effizienz, weniger Qubits

Jetzt ist es theoretischen Quanteninformatikern gelungen, Algorithmen effizienter zu gestalten, sodass sie weniger Qubits und Rechenoperationen benötigen. Dadurch hat sich die Schätzung der erforderlichen physikalischen Qubits für die Primfaktorzerlegung etwa alle fünf Jahre um eine Größenordnung verringert. Zuletzt zeigte der Google-Forscher Craig Gidney, dass sich die Anzahl von 20 Millionen auf rund eine Million Qubits senken lässt – unter anderem, indem er Abfolgen von Gattern in komplexe dreidimensionale Muster übersetzte. Dazu habe er viel mit geometrischer Intuition gearbeitet, sagt der Forscher. Er glaubt, dass seine Umsetzung der Fehlerkorrektur nahe am theoretischen Optimum liege, schließt aber nicht aus, dass verbesserte Verfahren die erforderliche Qubitzahl weiter verringern könnten.

»Mathematisch gesehen wird die Theorie der Quantenfehlerkorrektur immer reichhaltiger und interessanter. Es hat eine regelrechte Explosion an Veröffentlichungen gegeben«Barbara Terhal, Quantenphysikerin

Nathalie de Leon sagt: »Im Moment dreht sich alles darum, wie man Fehlerkorrektur effizienter gestalten kann.« Dafür gebe es mehrere Ansätze. Zum Beispiel kann man Verfahren entwickeln, die die Information eines logischen Qubits in weniger physikalischen Qubits codieren. Ebenso wichtig ist es, die Fidelität (die Genauigkeit) der Gatteroperationen und die Qualität der physikalischen Qubits zu verbessern: Je weniger fehleranfällig diese sind, desto seltener muss korrigiert werden – und desto geringer fällt der Bedarf an physikalischen Qubits aus.

Die theoretische Physikerin Barbara Terhal vom QuTech-Institut für Quantentechnologie der Technischen Universität Delft warnt jedoch, dass komplexe Fehlerkorrekturcodes auch Nachteile mit sich bringen, weil sie die Durchführung von Gatteroperationen erschweren. Zugleich hebt sie positiv hervor: »Mathematisch gesehen wird die Theorie der Quantenfehlerkorrektur immer reichhaltiger und interessanter. Es hat eine regelrechte Explosion an Veröffentlichungen gegeben.«

Das Unternehmen IBM hat ein Verfahren perfektioniert, das logische Qubits mit nur einem Zehntel der sonst üblichen Anzahl physikalischer Qubits realisieren soll – also mit einem Verhältnis von etwa 100 zu 1. Das Start-up QuEra experimentiert mit Methoden, die eine besondere Stärke seiner Neutralatom-Qubits ausnutzen: ihre Flexibilität, sich gezielt bewegen und verschränken zu lassen. Prinzipiell ließe sich auch so das Verhältnis von physikalischen zu logischen Qubits auf etwa 100 zu 1 senken, sagt QuEra-Gründer Mikhail Lukin, Physiker an der Harvard University. Voraussetzung dafür sei allerdings, dass die Fidelität der Zwei-Qubit-Gatter von derzeit etwa 99,5 Prozent auf rund 99,9 Prozent steigt – was Lukin für realistisch hält. »Wir sind auf dem Weg zu den ›drei Neunen‹«, sagt er.

De Leon wiederum konzentriert sich darauf, die Schwachstellen von Qubits mithilfe hochpräziser Messtechnik zu untersuchen. Ein zentrales Problem supraleitender Qubits ist ihre kurze Lebensdauer: Noch während ein Algorithmus räumlich getrennte Qubits auf demselben Chip ansteuert, zerfällt die gespeicherte Information bereits. »Die Qubits sterben, während sie darauf warten, dass man die nächste Rechenoperation ausführt«, sagt sie. Mit ihrem Team führte sie hochpräzise Messungen an supraleitenden Qubits durch, um die Quellen elektromagnetischer Störsignale zu identifizieren, die deren Lebensdauer begrenzen. Anschließend ersetzte sie supraleitende Schleifen aus Aluminium durch solche aus Tantal und tauschte das Trägermaterial Saphir gegen isolierendes Silizium. Zusammengenommen verlängern diese Änderungen die Lebensdauer von 0,1 auf 1,68 Millisekunden, wie die Forschungsgruppe im November 2025 in der Fachzeitschrift »Nature« berichtete. De Leon glaubt, dass weiteres Potenzial besteht. »Es gibt naheliegende Maßnahmen, die wir ausprobieren möchten – ich denke, wir können damit 10 oder 15 Millisekunden erreichen.« Gleichzeitig betont sie, dass nach der Beseitigung eines Störsignals oft ein anderes unerwartet zum Vorschein kommt.

Beeindruckende Rekordwerte

Andere Gruppen arbeiten daran, Fidelitäten zu erreichen, die vor Kurzem noch undenkbar waren. Im Juni 2025 berichteten Forschende über ein Einzel-Qubit-Gatter mit einer Präzision von 99,999985 Prozent: fast sieben Neunen und damit eine Größenordnung besser als der bisherige Rekord. Es ist das präziseste Einzel-Qubit-Gatter, das je realisiert wurde – und das ganz ohne Änderungen an der zugrunde liegenden Hardware. Laut der Physikerin Molly Smith von der University of Oxford, die das Experiment durchführte, hatten kleine Justierungen an den Mikrowellen‑ und Laserpulsen unerwartete Effekte gezeigt. »Wir dachten nur: Wow, mal sehen, wie weit wir das noch treiben können«, erinnert sie sich.

Gatter, an denen zwei oder mehr Qubits beteiligt sind, weisen in der Regel höhere Fehlerraten auf als solche mit nur einem Qubit. Das Quantencomputing-Start-up Oxford Ionics – das 2025 mit IonQ fusionierte – vermeldete, es habe bei Zwei‑Qubit‑Operationen eine Fidelität von vier Neunen, also 99,99 Prozent, erreicht. Hierbei dienen Ionen als Qubits. Und auch anderswo wird nachgelegt: Das israelische Start-up Quantum Transistors aus Binyamina gab im Dezember desselben Jahres bekannt, Zwei‑Qubit‑Operationen mit einer Genauigkeit von 99,9988 Prozent durchgeführt zu haben – nahezu fünf Neunen. Die Qubits basieren hier auf den Zuständen eines Elektrons in einem Diamantkristall mit gezielt eingebrachten Fremdatomen.

»Wir haben immer gesagt, dass wir bis zum Ende dieses Jahrzehnts Anwendungen für den praktischen Einsatz liefern werden – und daran hat sich nichts geändert«Hartmut Neven, Leiter von Googles Quantum AI Lab

Wie der Physiker Chris Langer von Quantinuum erklärt, seien solche Rekordwerte zwar beeindruckend, aber sie würden immer nur gezielt eine einzelne Operation an einem bestimmten Bauteil optimieren. Bis sich dieselbe Qualität in einem vollständig funktionierenden System mit reproduzierbarer Leistung erreichen lasse, könnten zwei oder mehr Jahre vergehen. Chris Ballance, Physiker am Oxford-Ionics-Labor von IonQ, ist dennoch zuversichtlich, dass seine Gruppe bald vergleichbare Leistungen in einem größeren System umsetzen wird.

Manche Unternehmen zeigen sich bereits seit Langem optimistisch, in absehbarer Zeit fehlertolerante Quantencomputer in großem Maßstab zu realisieren. »Wir haben immer gesagt, dass wir bis zum Ende dieses Jahrzehnts Anwendungen für den praktischen Einsatz liefern werden – und daran hat sich nichts geändert«, sagt Hartmut Neven, Leiter von Googles Quantencomputing-Sparte. Neu ist jedoch, dass diese Ankündigungen inzwischen einigermaßen realistisch wirken, während sie früher oft als überzogener Hype galten – selbst wenn die meisten Fachleute die genannten Zeitpläne weiterhin kritisch sehen.

IonQ zeigt sich besonders offensiv und erklärt, die Maschinen könnten bis Ende der 2020er-Jahre die Primfaktorzerlegung großer Zahlen meistern. »Wir brauchen für dieselben Anwendungen 10- bis 1000-mal weniger Qubits als unsere Wettbewerber«, behauptet Ballance. Kritikerinnen und Kritiker halten dagegen, das Unternehmen habe entsprechende Rechner bislang noch nicht realisiert.

Für supraleitende Qubits könnten laut de Leon vor allem längere Lebensdauern eine entscheidende Rolle spielen: »Wenn wir auf zehn Millisekunden kommen, reduzieren wir den Overhead vermutlich um den Faktor zwei oder drei.« Zusammen mit weiteren Verbesserungen könnte das ausreichen, um mit 30 000 bis 50 000 Qubits bereits große Zahlen zu faktorisieren.

Funktionstüchtige Quantenrechner zu bauen, stellt inzwischen vor allem eine ingenieurtechnische Herausforderung dar

Damit rücken Systeme in Reichweite, die Unternehmen gern in einem einzigen Kryostat unterbringen würden – um so das Problem zu umgehen, mehrere Kühlsysteme miteinander verbinden zu müssen. Mit heutiger Technik ließen sich rund 10 000 Qubits in Googles größten Kryostaten integrieren, sagt Neven. Ein großes Hindernis war bislang, dass man jedes einzelne Qubit über Kabel mit Elektronik verbinden muss, die sich außerhalb des Kühlsystems befindet. Künftig könnte diese jedoch direkt im kältesten Bereich des Geräts untergebracht und in den Quantenchip integriert werden. Dann wären nach Nevens Einschätzung sogar Hunderttausende Qubits in einer einzigen Maschine denkbar.

Andere Fachleute mahnen jedoch zur Zurückhaltung. Unternehmen würden naturgemäß die Stärken ihrer Systeme betonen, erklärt der Physiker John Martinis, ehemals leitender Forscher bei Google und Nobelpreisträger des Jahres 2025. Doch funktionstüchtige Rechner zu bauen, stelle inzwischen vor allem eine ingenieurtechnische Herausforderung dar: das Zusammenspiel aller Komponenten. Am Ende sei ein System nur so gut wie sein schwächstes Glied.

Martinis verfolgt derzeit einen ganzheitlichen Ansatz zur Neugestaltung supraleitender Qubits. »Wir versuchen, die Bauteile auf eine völlig neue Weise herzustellen«, sagt er. Das Start‑up Qolab, das er mitgegründet hat, arbeitet dazu mit dem Halbleiterkonzern Applied Materials in Santa Clara zusammen, um Fertigungstechniken moderner Computerchips zu nutzen. Ziel sei es, riesige Chips mit einem Durchmesser von 300 Millimetern zu entwickeln, die 20 000 oder mehr supraleitende Qubits tragen können – und in einen herkömmlichen Kryokühler passen.

Der Weg zur vollständigen Fehlertoleranz wird kein einfacher sein. Viele Forschende glauben weiterhin, dass es länger dauern wird, als führende Unternehmen prognostizieren. »Es gibt etliche große Baustellen, die noch nicht ausreichend durchdacht sind«, sagt Jens Eisert, der gemeinsam mit John Preskill vom California Institute of Technology mehrere dieser Engpässe in einer Übersichtsarbeit beschrieben hat. Dennoch haben auch er und andere ihre Einschätzungen korrigiert. Aus den vagen Versprechen der vergangenen Jahre sind nun konkrete Entwicklungsziele geworden.

Wenn Sie inhaltliche Anmerkungen zu diesem Artikel haben, können Sie die Redaktion per E-Mail informieren. Wir lesen Ihre Zuschrift, bitten jedoch um Verständnis, dass wir nicht jede beantworten können.