Warkus’ Welt: Kann KI denken und fühlen?

Wenn man mir noch vor fünf Jahren gesagt hätte, dass 2025 zwei Drittel aller Deutschen zumindest gelegentlich Unterhaltungen mit einem Computer führen würden, hätte ich es vermutlich nicht geglaubt. Aber es ist geschehen. Künstliche Intelligenz in der aktuell etablierten Form von Large Language Models (LLMs) ist ein Produkt mit ähnlicher Verbreitung wie Pizzaservices und etwa doppelt so populär wie öffentliche Bibliotheken.

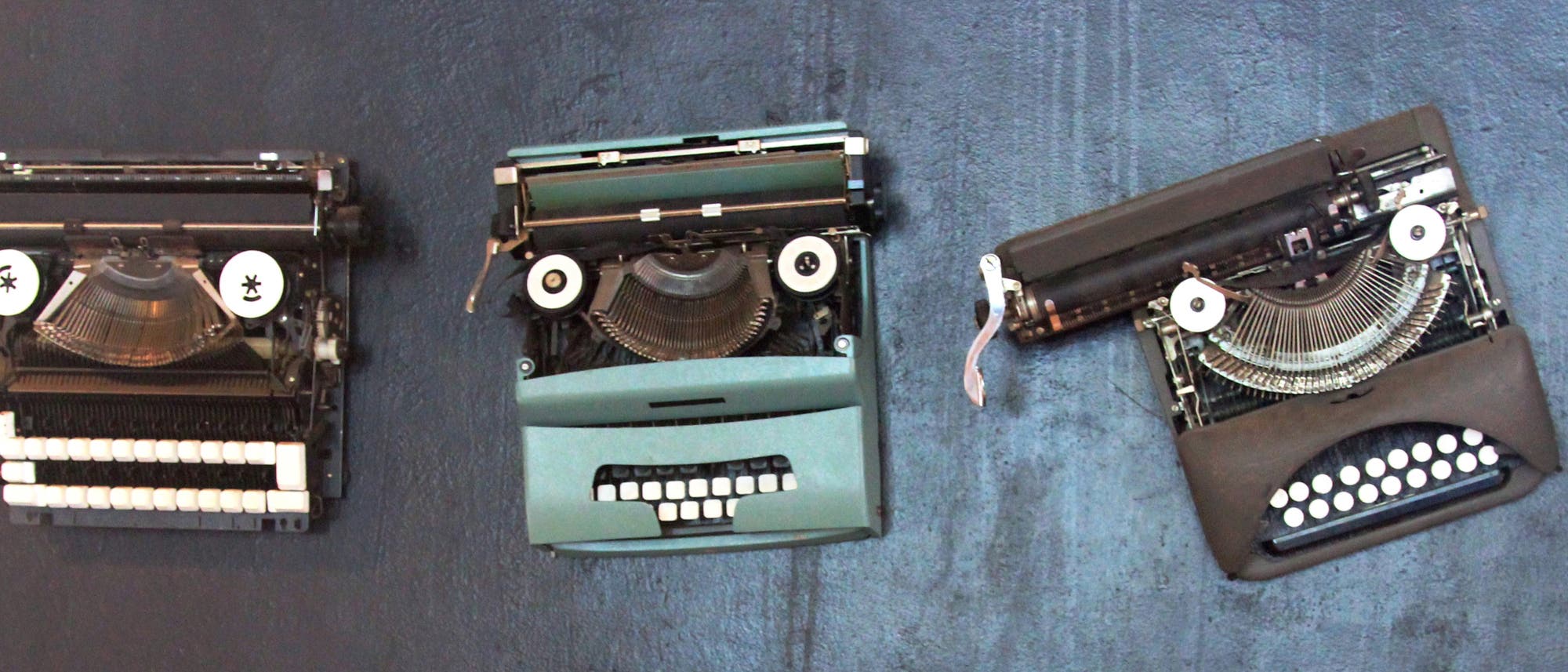

Dass sich diese Technik sehr schnell verbreitet hat und heftig über sie gestritten wird, ist kein Alleinstellungsmerkmal großer Sprachmodelle. Ziemlich einzigartig dürfte jedoch sein, dass völlig unterschiedliche philosophische Einschätzungen dessen, womit man es da zu tun hat, im Umlauf sind. So ist es ein beliebtes Argument, darauf hinzuweisen, dass man es letztlich nur mit einer extrem leistungsfähigen Assoziationsmaschine, einem »stochastischen Papageien«, zu tun habe – einer höher entwickelten Form von Chatbots, wie sie schon seit Mitte der 1960er-Jahre existieren.

Enthusiasten sprechen bereits von Bewusstsein

Man trifft aber, vor allem auf der Seite der Entwickler und Enthusiasten, auch auf völlig andere Einschätzungen. Die schottische Philosophin Amanda Askell, sozusagen die »Chef-Ethikerin« des KI-Unternehmens Anthropic, das das KI-Modell »Claude« anbietet, hat am 24. Januar 2026 in einem Interview angedeutet, dass sie sich nicht mehr sicher sei, ob die gängigen LLMs nicht vielleicht doch Bewusstsein zeigen und fähig sind, »zu fühlen«. Diese Äußerung steht in einer Reihe vorheriger, ähnlich kontroverser Aussagen aus der Branche.

Nun ist es notorisch schwierig, aus der Außenperspektive etwas über das Bewusstsein einer nichtmenschlichen Entität auszusagen. In der Philosophie gibt es immerhin eine Tradition, sogar aus der ersten Person am eigenen Bewusstsein zu zweifeln. Auf das berühmte »Ich denke, also bin ich« von René Descartes (1596–1650) folgte die klassische Entgegnung von Georg Christoph Lichtenberg (1742–1799): Viel mehr als »es denkt« könnte man nicht begründet sagen, die Unterstellung des Ichs sei bloß »praktisches Bedürfnis«. Zudem ist es in der modernen Philosophie des Geistes – die sich schon zu Zeiten, als man noch einen Lastwagen brauchte, um einen Computer von A nach B zu bewegen, intensiv mit der Frage intelligenter Rechner befasste – nicht unüblich, sogar extrem simplen Systemen Eigenschaften wie Überzeugungen oder Bewusstsein zuzuschreiben. Demnach kann ein Thermostat meinen, dass es zu kalt im Zimmer sei. Oder ein Barcode-Scanner kann sich selbst erkannt haben, wenn er sein eigenes Etikett im Spiegel ausliest.

Wir haben also zwei weitgehend separate Arten und Weisen, über Phänomene wie Bewusstsein, Vernunft und Empfindungsvermögen zu sprechen: eine umgangssprachliche, vergleichsweise enge, und eine philosophische, mitunter extrem weite. Ist es da sinnvoll, überhaupt irgendetwas mithilfe solcher Begriffe zu diskutieren? Ist vielleicht gar nichts damit gewonnen, einen Taschenrechner als bewusstlos, eine Katze als (wahrscheinlich) empfindungsfähig und einen Menschen als intelligent, bewusst und reflektiert zu bezeichnen?

Alan Turings Imitationstest

Der große Mathematiker, Computertheoretiker und Philosoph Alan Turing (1912–1954) hat 1950 in seinem legendären Aufsatz »Computing Machinery and Intelligence« ein praktisches Testverfahren für maschinelles Denken vorgeschlagen. Er beschreibt eine Art Partyspiel: Ein Mann und eine Frau kommunizieren verdeckt (zum Beispiel über Fernschreiber) mit einer Testperson, die herausfinden soll, wer von beiden wer ist. Dabei lügt einer der Gesprächsteilnehmer über sein Geschlecht, der andere sagt die Wahrheit. Turing schlägt nun das Gedankenexperiment vor, dass eine Maschine den Platz des lügenden Gesprächspartners einnimmt. Ihre Denkfähigkeit soll sich dann an der Fähigkeit messen, das Spiel mit der Unwahrheit auf dieser Position genauso gut zu spielen wie ein Mensch.

Aktuelle LLMs, zumindest ihre Premiumversionen, beherrschen Turings Imitationsspiel sicher ganz brauchbar. Aber Hand aufs Herz: Macht das für Sie irgendeinen Unterschied? Ich würde vermuten, dass Ihre Meinung dazu, ob eine KI wirklich »denken«, »fühlen«, »sich ihrer selbst bewusst« sein kann, tief in Ihnen drinnen durch die Ergebnisse bei diesem Test nicht beeinflusst wird. Nur: Was müsste sonst passieren? Könnte überhaupt etwas passieren, was uns in unserer Meinung dazu, ob eine Maschine denken kann, umstimmt? Ich habe für mich selbst keine Antwort. Haben Sie eine für sich?

Schreiben Sie uns!

Beitrag schreiben