Teilchenphysik: Der große Neustart des LHC

Mike Lamont greift sich das letzte Croissant von einem Tisch und isst es, während er durch das Kontrollzentrum des CERN nahe Genf schlendert. Es ist Vormittag, und der große Raum am europäischen Labor für Teilchenphysik ist gefüllt mit Wissenschaftlern, die auf Computerbildschirme starren. Man führe gerade Tests durch, erklärt Lamont als Betriebsleiter des Beams Departments am CERN. Dadurch wollen die Forscher sicherstellen, dass sich ein unerwarteter Computerausfall nicht negativ auf das Netz aus Elektronik, Vakuumröhren und supraleitenden Magneten des LHC auswirkt – des leistungsstärksten Teilchenbeschleunigers der Welt.

Dies ist nur eine von zahllosen Kontrollen, die Lamont und seine Kollegen nachts besser schlafen lassen. Denn sie stehen kurz davor, den im März 2013 begonnenen Umbau des LHC abzuschließen. Für den Neustart im kommenden Jahr kühlt das Team bereits die supraleitenden Magneten des 27 Kilometer langen Beschleunigerrings auf deren Betriebstemperatur herunter. Wenn der LHC dann wieder zum Leben erwacht, wollen Lamont und seine Kollegen die beiden gegenläufigen Protonenstrahlen im Ring auf Energien von jeweils sieben Teraelektronenvolt (TeV) beschleunigen – jeder Strahl enthält damit so viel Energie wie ein schnell fahrender Güterzug. Bisher ließ sich im LHC nur gut die Hälfte dieser ursprünglich angestrebten Energie erreichen.

Lamont weiß nur zu gut, was passieren kann, wenn etwas schiefgeht: Er war dabei, als das Team im September 2008 das letzte Mal versuchte, die fünf Milliarden US-Dollar teure Maschine auf solche Energien zu bringen – und eine technische Störung auftrat. Infolgedessen musste der Beschleuniger für mehr als ein Jahr aussetzen und es fielen Reparaturkosten von zig Millionen Dollar an.

Bei hohen Energien lassen sich vielleicht andere neue, exotische Teilchen erzeugen, die das Standardmodell nicht vorsieht

"Wir haben seitdem eine Menge über die Maschine gelernt", sagt Lamont. Die Forscher konnten den Beschleuniger reparieren und ihn bis Ende 2009 wieder zum Laufen bringen – wobei sie ihm nur die Hälfte der ursprünglich anvisierten Energie zumuteten, um einen weiteren Ausfall zu vermeiden. Die Protonenkollisionen lieferten aber auch so stichhaltige Beweise für das lange gesuchte Higgs-Boson – die letzte unbestätigte Vorhersage des 40 Jahre alten Standardmodells der Teilchenphysik, welches das Verhalten von allen bekannten Teilchen und Kräften beschreibt, abgesehen von der Schwerkraft. Die im Juli 2012 verkündete Entdeckung des Higgs-Teilchens – und der 2013 verliehene Nobelpreis an zwei Theoretiker, die dessen Existenz erstmals vorhergesagt hatten – sorgten für viel Jubel. Doch der LHC, so hoffen Physiker, könnte in der bevorstehenden Betriebsphase noch weitaus mehr leisten. Handelt es sich bei dem neu entdeckten Higgs-Teilchen um das einzige seiner Art, wie es das Standardmodell annimmt, oder stellt es nur das leichteste Mitglied einer ganzen Familie dar? Sollte es tatsächlich weitere Higgs-Teilchen geben, zeigen sich einige von ihnen womöglich bei höheren Kollisionsenergien. Und vielleicht lassen sich bei den hohen Energien andere neue, exotische Teilchen erzeugen, die das Standardmodell nicht vorsieht.

Theoretiker sagen solche Teilchen bereits seit Jahrzehnten vorher. Etwa im Rahmen der Supersymmetrie, einer erstmals in den frühen 1970er Jahren vorgeschlagenen Erweiterung des Standardmodells: Jedes Teilchen verfügt demnach über ein massereicheres Gegenstück oder "Sparticle", wobei sich die beiden in vorhersagbarer Weise unterscheiden. Eines oder mehrere solcher Sparticles könnten sich als Bestandteile der Dunklen Materie entpuppen. Dieser unsichtbare Stoff macht mehr als 80 Prozent der Materie im Universum aus und wird nicht vom Standardmodell erklärt. Diese Sparticles aufzuspüren – vorausgesetzt sie sind nicht zu massereich, um bei den Energien im LHC zu entstehen –, wird somit zu einem wesentlichen Ziel für den aufgerüsteten Beschleuniger. Es wären sogar noch exotischere Funde denkbar, beispielsweise Hinweise auf räumliche Dimensionen jenseits der vertrauten drei. Zunächst einmal müssen Lamont und sein Team es allerdings schaffen, den LHC mit voller Leistung zu betreiben.

Knacken und Zischen

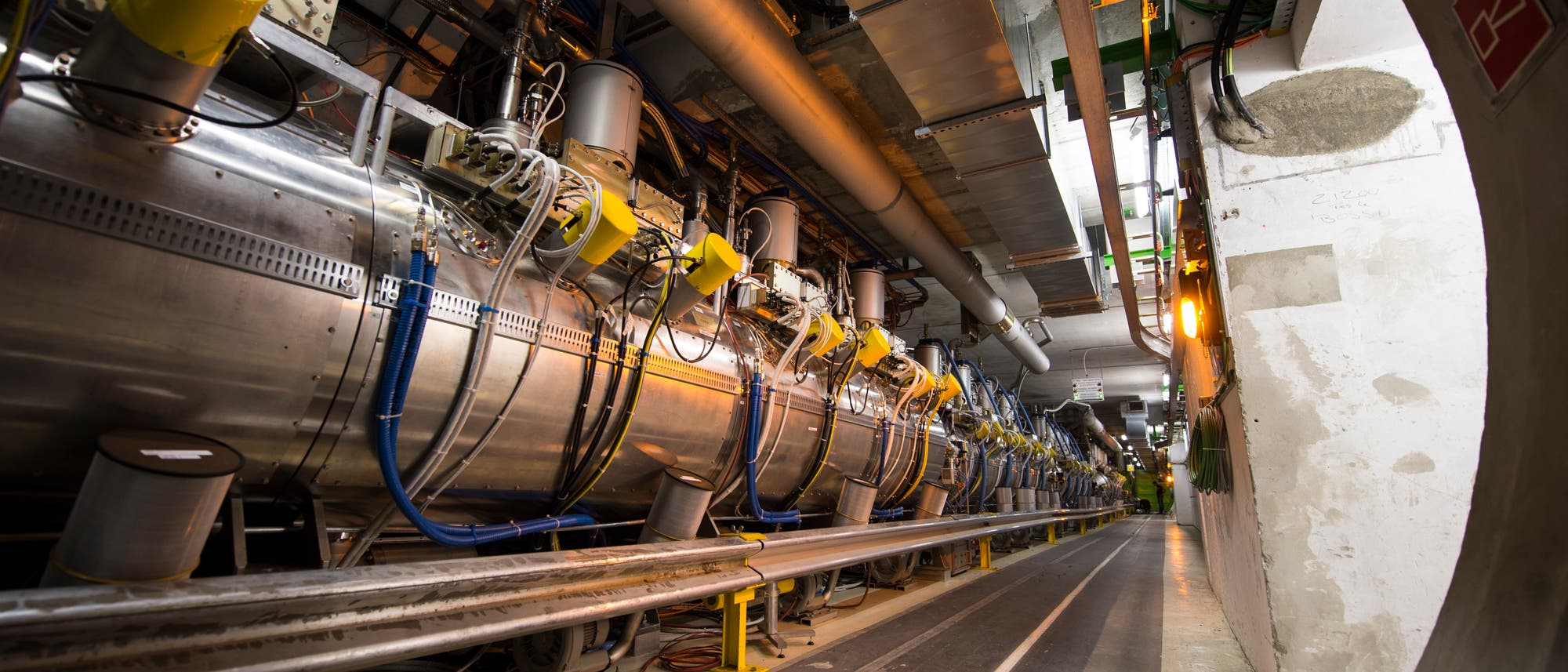

Nach einer kurzen Fahrt vom Kontrollzentrum, setzt Lamont einen Helm auf, schlüpft in Sicherheitsschuhe und packt Druckluftatmungsgeräte ein, um dann in einen Aufzug zu steigen, der uns 100 Meter unter die Erde befördert. Als sich die Aufzugtüren öffnen, betreten wir zunächst einen Wartungskorridor. Von hier führt ein kurzer Weg zum eigentlichen LHC-Tunnel, in dem sich zylindrische, leuchtend blaue Magneten aneinanderreihen und in der Ferne eine sanfte Kurve beschreiben.

Auch nach 25 Jahren am CERN, berichtet Lamont, flöße ihm die Leistungsfähigkeit und Komplexität der Maschine noch Ehrfurcht ein. Der LHC-Tunnel scheint Lichtjahre weit entfernt von der konzentrierten Ruhe im Kontrollraum. Hier unten brummt, knackt und zischt der Beschleuniger und es riecht nach Metall, Staub und aufgeheizten Schaltkreisen. Massive Stützböcke halten die 15 Meter langen und 35 Tonnen schweren Magneten über dem Betonboden. Inmitten von ihnen verlaufen die luftdichten Strahlrohre, umgeben von weiteren Rohrleitungen und aufwändigen Verkabelungen. Um einen weiteren Kurzschluss abzuwenden, stattete man den LHC mit Sensoren und tausenden Kilometern an Kabeln aus, so dass die geringsten Anzeichen eines Spannungsanstiegs erkennbar waren. Zudem verstärkte oder ersetzte man 10 000 der supraleitenden Verbindungen zwischen den Magneten – mit dieser Aufgabe waren 250 Leute mehr als ein Jahr beschäftigt.

Seit Juni kühlt das Team die Magnete auf deren Betriebstemperatur ab – erst bei 1,9 Grad über dem absoluten Nullpunkt werden die stromführenden Kabel, welche die Magnetfelder hervorrufen, supraleitend. Um diesen Prozess kontrollierbar zu halten, teilte man den LHC-Ring in acht Abschnitte, die sich unabhängig voneinander kühlen lassen. Sobald die Magnete die erforderliche Temperatur erreicht haben, was pro Abschnitt zwei Monate dauert, wird das Team die elektrische Funktionalität überprüfen und sich so vergewissern, dass der Beschleuniger auch bei hohen Energien betrieben werden kann. Lamont ahnt bereits, dass nicht alles reibungslos laufen wird. Es gibt mehrere Magneten, die in Tests vor dem Einbau einwandfrei abschnitten. Doch sobald diese nun Magnetfeldstärken erreichen, die einer Strahlenergie von nur 6,5 TeV entsprechen, verlieren sie aus irgendeinem Grund ihre Supraleitfähigkeit. Dieser so genannte Quench ist zwar nicht dramatisch, denn durchläuft man mit betroffenen Magneten mehrere Quenches, funktionieren sie wieder ordnungsgemäß. "Aber das kostet Zeit", sagt er. "Und es gibt Hunderte von diesen Quälgeistern!"

Früher oder später werden jedoch wieder Protonenstrahlen durch den LHC jagen – derzeit ist der Neustart für März 2015 geplant. Nach weiteren Tests, die einige Wochen in Anspruch nehmen dürften, wollen die Physiker die Teilchenstrahlen dann vorsichtig zur Kollision bringen. Dabei werden sie unter anderem prüfen, ob die Detektoren sicher mit der Datenaufnahme beginnen können.

Es riecht leicht verbrannt im Tunnel. Lamont erklärt, dass gerade ein Vakuumrohr erhitzt wird, um Fremdmoleküle zu entfernen. Er geht an den Magneten entlang zu einer Stelle, an der das freigelegte Strahlrohr durch eine massive Kupfer- und Stahlwand dringt. Auf der anderen Seite befindet sich ATLAS, einer der vier großen Teilchendetektoren am LHC. Schon bald werden hochenergetische Protonenpakete durch diesen Abschnitt hinein in ATLAS rauschen, wo sie mit ebenso energiereichen Protonen zusammenstoßen, die in entgegengesetzter Richtung durch den LHC rasten. Die bei der Kollision entstehenden Trümmer fliegen dann durch den Detektor nach außen. "Insgeheim denkt man sich: Du lieber Himmel, die lassen uns hier einen Strahl durchfeuern?", sagt Lamont. "Ich kann immer noch nicht glauben, dass ich dafür bezahlt werde, an diesem Ding herumzuspielen."

Systemupdates

Rund achteinhalb Kilometer von ATLAS entfernt, auf der gegenüberliegenden Seite des LHC-Rings, blickt Tiziano Camporesi auf den 12 500 Tonnen schweren "Compact Muon Solenoid" (CMS) – und staunt über den Wagemut der Physiker, die diesen Detektor vor 30 Jahren entwickelt haben. "Sie müssen verrückt gewesen sein", sagt er. Viele hielten den Detektor – einen großen Zylinder mit konzentrischen Schichten aus Teilchensensoren auf Siliziumbasis, supraleitenden Magneten und massiven Eisenjochs, um das Magnetfeld einzugrenzen – für zu komplex, um jemals zu funktionieren. Doch es klappte, berichtet Camporesi, und zwar "viel besser, als wir je erwartet hatten". Mit CMS und ATLAS gelang 2012 der Nachweis des Higgs-Bosons.

Früher oder später werden wieder Protonenstrahlen durch den LHC jagen – derzeit ist der Neustart für März 2015 geplant

Als Sprecher der CMS-Kollaboration, in der sich 3800 Wissenschaftler zusammengeschlossen haben, koordiniert Camporesi derzeit die Aktivitäten für den Betrieb im kommenden Jahr. Neben seinem führten auch alle anderen Teams an den großen LHC-Experimenten (zu denen auch die etwas spezialisierteren Detektoren ALICE und LHCb gehören, die sich an anderen Abschnitten des Beschleunigerrings befinden) während der Betriebspause einige dringend nötigte Reparaturen und Upgrades durch. Ein Befund war dabei besonders erfreulich: Die empfindlichen Siliziumspurdetektoren im zentralen Bereich des Detektors, wo sich die Protonenstrahlen treffen und die dabei erzeugten Teilchen von der Kollisionsstelle nach außen schießen, weisen bisher keine Strahlenschäden auf. Allerdings mussten die Physiker am CMS-Detektor mehrere fehlerhafte Photomultiplier ersetzen. Denn die gemessenen Signale hatten es so aussehen lassen, als wäre ein exotisches neues Teilchen erzeugt worden – obwohl dies nicht der Fall war.

Besonders stolz ist Camporesi auf vier scheibenförmige Kammern an beiden Enden des CMS-Detektors. Mit diesen neu hinzugefügten Komponenten wollen die Forscher künftig als Myonen bezeichnete Teilchen besser nachweisen. Dieses Upgrade dürfte wiederum den "Trigger" des Detektors optimieren – diese Kombination aus Elektronik und Software sichtet die vom Kollisionspunkt ausgehenden Teilchen und sucht nach Mustern, die auf ein interessantes Ereignis hindeuten. Physiker nutzen solche Trigger bereits seit Jahrzehnten, berichtet Camporesi. Doch in der nächsten Betriebsphase des LHC wird nicht nur die Energie der einzelnen Protonenstrahlen erhöht, auch die Anzahl der Protonen darin wird steigen. Infolgedessen werden pro Sekunde rund ein bis zwei Milliarden Kollisionen im CMS stattfinden. Während die aus einer Kollision hervorgegangenen Teilchen noch den Detektor durchqueren, ereignen sich hinter ihnen bereits bis zu 50 weitere Kollisionen. Welche dieser vielen Ereignisse für eine spätere Analyse archiviert werden, wird der Trigger entscheiden müssen. Schlussendlich sollen aber nur einige hundert Ereignisse pro Sekunde gespeichert werden, so das erklärte Ziel. "Das nimmt derzeit viel Zeit in Anspruch", sagt Camporesi.

Big Data

Sobald der LHC wieder läuft, strömen die unverarbeiteten elektronischen Signale von CMS und den anderen Detektoren durch Lichtwellenleiter zum Hauptcampus des CERN, direkt in das Rechenzentrum – ein stickiger, fensterloser Raum, in dem rund 100 000 Prozessoren in reihenweise Racks untergebracht sind und Lüfter laut surren, um die Abwärme abzuführen.

Die Prozessoren werden die eingehenden Daten mit Hilfe von Algorithmen analysieren, die Identität, Energie und Flugrichtung eines jeden Teilchen aus einer jeden Kollision bestimmen. Die Ergebnisse werden dann auf einem Magnetband gespeichert – dieses altmodische Medium ist nicht nur kostengünstiger, sondern auch langlebiger als digitale Speichermedien.

Die Daten werden allerdings nicht einfach am CERN archiviert. Schließlich können Wissenschaftler aus allen Teilen der Erde es kaum erwarten, die aufgezeichneten Ereignisse zu analysieren. Tatsächlich verbringen Teilchenphysiker heutzutage die meiste Zeit damit, Tausende von Kommandozeilen zu schreiben und mit den so entwickelten Programmen in Millionen von Kollisionen nach auffälligen Signalen zu suchen. Damit Forscher auf die LHC-Daten zugreifen können, entwickelte man am CERN das "Worldwide Computing Grid": In diesem Netzwerk schickt man Kopien der Daten an 13 weltweit verteilte Rechenzentren der Ebene "Tier-1". Diese Zentren sind wiederum mit mehr als 150 nachgeordneten Tier-2-Einrichtungen verbunden – die meisten stehen an Universitäten.

Wie das LHC Computing Grid im Einzelnen funktioniert, müssen die Endnutzer aber – zu ihrem Glück – gar nicht wissen. Die Physiker übermitteln lediglich ihr Programm an das Grid und geben an, welche Kollisionsereignisse untersucht werden sollen. Daraufhin leitet die Grid-Software den Auftrag automatisch an ein Zentrum mit genügend Rechenleistung und ausreichend freiem Speicherplatz dafür und schickt schließlich die Ergebnisse zurück. Allein am Rechenzentrum des CERN laufen an diesem Tag 10 500 Programme, wie ein Bildschirm anzeigt – und das stellt nur sechs Prozent der Rechenressourcen im Grid dar. Ohne das Grid, sagt Jeremy Coles von der University of Cambridge und Grid-Koordinator in Großbritannien, würden seine Kollegen wahrscheinlich immer noch nach dem Higgs-Boson suchen.

Die künftige Herausforderung wird sein, sagt der Physiker, mit den extrem hohen Ereignisraten umzugehen. Während der ersten Betriebsphase des LHC häuften sich, trotz radikaler Reduktion durch die Trigger der Detektoren, pro Jahr 15 Petabyte (15 000 Billionen Bytes) an Daten an – und damit mehr als durch alle Videos, die jährlich bei Youtube hochgeladen werden. In Zukunft soll sich die Kollisionsrate verdoppeln und so dürften pro Jahr rund 30 Petabyte an Daten anfallen – im Durchschnitt also etwa ein Gigabyte pro Sekunde.

Coles ist zuversichtlich, dass das Grid auch mit diesen Datenmengen fertig wird – nicht zuletzt auf Grund der technischen Fortschritte, die eine viel bessere Integration zwischen den Rechenzentren ermöglicht haben. "Die Netzwerktechnik hat sich in den letzten zehn Jahren sehr schnell weiterentwickelt", erläutert der Wissenschaftler, "mehr als wir dachten." Erst im vergangenen Jahr vernetzte man beispielsweise das Rechenzentrum am CERN – das an den Grenzen des verfügbaren Speicherplatzes und seiner Leistungsfähigkeit angelangt war – über zwei Glasfaserkabel mit einem Rechenzentrum in Budapest und erhöhte so dessen Kapazität. Dank Übertragungsraten von 100 Gigabit pro Sekunde erscheint es den Nutzern so, sagt Coles, als stünde der Rechner im Nebenraum.

Und ein Ende der Datenflut ist nicht in Sicht. Anfang der 2020er Jahre wird das jährliche Datenvolumen nach weiteren Upgrades des LHC voraussichtlich auf 110 Petabyte steigen, und schließlich auf bis zu 400 Petabytes pro Jahr. "Momentan könnten wir das nicht bewältigen", sagt Coles. Erschwerend kommt hinzu, dass die Geschwindigkeiten von Computerchips stagnieren. Die derzeit besten kommerziellen Chips enthalten meist zwei, vier oder acht Prozessoren, um ihre Leistung zu steigern. Künftige Chips werden wahrscheinlich sogar noch mehr Prozessoren besitzen. Der am LHC verwendete Computerkode ist allerdings dafür ausgelegt, so Coles, jeweils nur auf einem Prozessor ausgeführt zu werden. Wollte man die Datenanalyse auf vielen Prozessoren parallel ausführen, müsste man 15 Millionen Kommandozeilen – geschrieben von Tausenden von Menschen über viele Jahre – umschreiben.

Doch die Wissenschaftler am LHC wirken optimistisch, auch dieses Problem irgendwie zu lösen. Genau wie Ende der 1980er Jahre, als die Physiker am CERN nach einem effizienten Weg suchten, um Informationen auszutauschen – das Ergebnis war das World Wide Web. Und als sie in den 1990er Jahren verfügbare Rechnerressourcen optimal ausnutzen wollten, erfanden sie das weltweit größte Rechen- und Speichernetzwerk.

Lamont wirkt ähnlich zuversichtlich, wenn er über den "nächsten großen Collider" der Teilchenphysik spricht. Obwohl das CERN gerade erst sein 60. Jubiläum feierte, und im LHC auch in den kommenden 20 Jahren noch Protonen miteinander kollidieren sollen, prüft das Forschungszentrum die Machbarkeit eines 80 bis 100 Kilometer langen Beschleunigerrings, mit dem sich noch tiefer in die Struktur der Materie blicken ließe. Würde eine solche Anlage noch zu seinen Lebzeiten errichtet, sagt Lamont, wäre er überglücklich. Die Planungen für den LHC, der 2008 erstmals in Betrieb ging, reichen bis ins Jahr 1984 zurück. "Wir müssen schon jetzt beginnen, über die nächste Maschine nachzudenken", schließt Lamont.

Dieser Artikel erschien unter dem Titel "The big reboot" in Nature 514, S. 158–160, 2014.

Schreiben Sie uns!

Beitrag schreiben